احتمالاً تا حالا دیگر درباره Dall-E یا چتبات ChatGPT یا «بینگ جدید» مایکروسافت چیزهایی شنیدهاید؛ بااینحال، بعید میدانم دربارهی شرکت توسعهدهنده هوش مصنوعی بهکار رفته در این پلتفرمها که این روزها با قابلیتهای خود کاربران اینترنتی را شگفتزده کرده است، چیز زیادی بدانید. اینکه این شرکت تأثیرگذار تا این حد ناشناخته است، از کمکاری من و شما نیست؛ بلکه OpenAI تعمداً مرموز و پنهانکار است و تعداد افرادی که در جریان پروژههای آن قرار دارند، بهطرز مشکوکی انگشتشمارند.

کارمندان OpenAI بهرسم هرسال دورهم جمع میشوند تا دربارهی زمانی شرطبندی کنند که رؤیای بشر برای دستیابی به «هوش مصنوعی قوی» به حقیقت خواهد پیوست. هوش مصنوعی قوی/عمومی (Artificial general intelligence) یا AGI همانی است که در فیلمهای علمیتخیلی نظیر ترمیناتور و Her میبینیم: سیستم دانای کل و خودآگاهی که در عین داشتن هوش انسانگونه و قابلیت استدلال و تفکر منطقی، تواناییهای فرابشری دارد (و معمولا منجر به نابودی زمین و نسل بشر میشود).

البته شرطبندی کارمندان OpenAI نوعی سرگرمی است و تخمینهای آنها اختلاف زیادی با یکدیگر دارد. بااینحال، در حوزهای که هنوز امکان دستیابی به سیستمهای خودمختار و خودآگاه موردبحث است، نیمی از کارمندان OpenAI واقعاً بر این باورند که دستیابی به AGI احتمالاً تا ۱۳ سال آینده صورت خواهد گرفت.

نیمی از کارمندان OpenAI معتقدند تا ۱۳ سال آینده به هوش مصنوعی قوی دست پیدا خواهند کرد

درواقع، مأموریت OpenAI این است که اولین شرکتی باشد که به هوش مصنوعی قوی دست پیدا میکند؛ اما نه برای تسلط کامل بر دنیا و بهزانودرآوردن جمعیت جهان، بلکه برای اطمینان از اینکه این تکنولوژی بسیار پرخطر بهطور ایمن توسعه داده شود و توزیع مزایای آن بهطور مساوی در جهان صورت گیرد (دستکم این چیزی است که خودشان ادعا میکنند!)

دانشمندان این حوزه عموماً بر این باورند که اگر توسعه AGI مسیری با کمترین مقاومت را دنبال کند؛ یعنی نهادی نباشد تا برای آن قوانین سختگیرانه وضع کند، بهراحتی میتواند از کنترل خارج شود. این ترس و نگرانی با نگاه به وضعیت هوش مصنوعی ضعیف، یعنی همین مدل پردردسری که امروزه بهشکل الگوریتمهای شبکههای اجتماعی دورمان را احاطه کرده، توجیهپذیر است.

اگر سیر تکامل الگوریتمها را به AGI تعمیم دهیم، میتوان مطمئن بود که در نبود هدایت و مدیریت «چوپانی» خیرخواه، فرجام این تکنولوژی فاجعهبار خواهد بود. درست حدس زدید، شرکت OpenAI میخواهد نقش این چوپان خیرخواه را برای هدایت توسعهی هوش مصنوعی قوی بهسمت مسیری درست و امن بازی کند. در شرایطی که حوزهی تکنولوژی هوش مصنوعی تحتکنترل غولهای دنیای فناوری نظیر گوگل و مایکروسافت است، OpenAI بهعنوان شرکت غیرانتفاعی تأسیس شد تا دستاوردهای آن برای «همه» ارزش ایجاد کند، نه برای سهامداران.

در منشور OpenAI آمده است که دستیابی به هوش مصنوعی قوی ازطریق روشهای امن چنان مهم است که اگر سازمان دیگری زودتر به این هدف نزدیک شد، این شرکت دست از رقابت برمیدارد و درعوض با آن سازمان همکاری میکند. همین موضعگیری منحصربهفرد و خیرخواهانه توجه رسانهها و سرمایهگذاران را جلب کرد؛ بهطوریکه در سال ۲۰۱۹، سرمایهگذاری یکمیلیارد دلاری مایکروسافت را بههمراه داشت و حالا این شرکت با ۱۰ میلیارد دلار سرمایهگذاری دیگر، ۴۹ درصد سهام OpenAI را در اختیار دارد.

و همانطورکه خودتان احتمالا از سیر تحولات اخیر حدس زدید، واقعیت ماجرا طور دیگری رقم خورد.

-

OpenAI چگونه شکل گرفت؟

-

چرا اینقدر پنهانکاری؟

-

دستاوردهای مهم OpenAI در حوزه هوش مصنوعی

-

منشور و استراتژی OpenAI

-

مشکلات OpenAI: نبود تنوع و بودجه

-

هوش مصنوعی قوی؛ پایان خلاقیت انسانی؟

OpenAI چگونه شکل گرفت؟

حوزهی هوش مصنوعی از همان ابتدا در تلاش برای درک هوش انسانی و یافتن روشهایی برای تقلید از آن بوده است. در سال ۱۹۵۰، آلن تورینگ، ریاضیدان و دانشمند کامپیوتر مشهور انگلیسی، مقالهای نوشت که با سؤال جنجالی «آیا ماشینها میتوانند فکر کنند؟» شروع میشد. شش سال بعد، گروهی از دانشمندان که مجذوب این ایده شده بودند، در کالج دارتموث گردهم آمدند تا چارچوب و اصول رشته هوش مصنوعی را تعیین کنند.

مشکل اینجا است که AGI از آن سال تاکنون، همچنان موضوع مبهمی باقی مانده است. هیچکس نمیتواند شکل احتمالی آن یا حداقل کاری را توصیف کند که از عهدهاش برمیآید. برای مثال، هنوز معلوم نیست که قرار است فقط یک مدل هوش مصنوعی قوی داشته باشیم یا بیشتر و اینکه شاید هوش انسانی تنها جزئی از کل باشد. افزونبراین، دیدگاهها درباره وظایف AGI نیز متفاوت است.

از دید رمانتیک، هوش ماشینی بینیاز از خواب و رها از ناکارآمدی تعاملات انسانی، میتواند مشکلات پیچیدهای همچون تغییرات اقلیمی و فقر و گرسنگی جهانی را حل کند. اکثر دانشمندان این حوزه معتقدند دستیابی به چنین قابلیتهای پیشرفتهای دهها سال یا حتی قرنها طول میکشد؛ البته اگر اصلاً توسعه چنین چیزی ممکن باشد. بسیاری نیز نگراناند که تلاش بیشازحد برای پیگیری این هدف ممکن است به عواقب جبرانناپذیری منجر شود.

در دهههای ۱۹۷۰ تا ۱۹۹۰، حوزه هوش مصنوعی سرشار از وعدههای بزرگ، اما اجرای ناامیدکننده بود. تا اینکه بودجه شرکتها ته کشید و زخمهای عمیقی بر نسلی از پژوهشگرانی بر جای گذاشت که تمام وقت خود را پای این پروژه گذاشته بودند. در این فضا بود که OpenAI در ۱۱ دسامبر ۲۰۱۵ با هیاهوی رسانهای به وادی هوش مصنوعی قدم گذاشت.

البته OpenAI اولین شرکتی نبود که قصد خود را برای دستیابی به AGI اعلام میکرد؛ چراکه شرکت DeepMind که در سال ۲۰۱۴ گوگل آن را ازآنِ خود کرد، پنج سال زودتر از شکلگیری OpenAI، وعده دستیابی به AGI را داده بود. گفتنی است این شرکت چند ماه پیش ادعا کرد در آستانه دستیابی به AGI قرار دارد.

مشکل AGI این است که هیچکس نمیداند قرار است چه شکلی باشد

اما داستان OpenAI فرق داشت؛ زیرا با سرمایهگذاری هنگفت یکمیلیارددلاری افراد نامآشنایی چون ایلان ماسک و سم آلتمن (رییس سابق Y Combinator) و پیتر تیل، همبنیانگذار پیپال تأسیس شد. این فهرست پرستاره از سرمایهگذاران درکنار اسامی به همین اندازه مشهور کارمندانش، هیاهوی رسانهای بزرگی بهراه انداخت. گرگ براکمن که زیرساختهای فنی شرکت فینتک Stripe زیرنظر او بود، مدیر ارشد فناوری OpenAI شد؛ ایلیا سوتسکور که زیرنظر جفری هینتون، پیشگام حوزه هوش مصنوعی، تحصیل کرده بود، مدیر تحقیقات شد؛ و هفت پژوهشگر تازهفارغالتحصیلشده از دانشگاههای برتر یا دستچینشده از شرکتهای دیگر نیز تیم فنی اصلی را تشکیل دادند.

ماسک فوریه ۲۰۱۸ اعلام کرد که بهدلیل اختلافنظر بر سر اهداف و برنامههای OpenAI از این شرکت جدا شده و حالا نه در این شرکت سهام دارد و نه عضو هیئتمدیره است و فقط گاهی دربارهی خطرات هوش مصنوعی برای تمدن بشر توییت میکند. یک ماه بعد، آلتمن از ریاست شتابدهنده Y Combinator کنارهگیری کرد تا مدیرعامل OpenAI شود. بدینترتیب، اعضای هیئتمدیره OpenAI حالا متشکل از گرگ براکمن (رییس و مدیر هیئتمدیره)، ایلیا سوتسکور (دانشمند ارشد) و سم آلتمن (مدیرعامل)، بههمراه افرادی که کارمند شرکت نیستند، ازجمله ادم دیآنجلو، رید هافمن، ویل هرد، تاشا مککالی، هلن تونر و شیون زیلیس است. در لیست سرمایهگذاران نیز بهجز مایکروسافت، نام موسسه خیریه رید هافمن و شرکت سرمایهگذاری کسلا ونچرز به چشم میخورد.

اما شاید چیزی که بیشتر از تیم پرستارهی سرمایهگذاران و اعضا، نام OpenAI را در زمان تاسیس بر سر زبانها انداخت، وضعیت غیرانتفاعی آن بود (که البته حالا به سود محدود تغییر ماهیت داده؛ به این معنی که سرمایهگذاران فقط میتوانند تا ۱۰۰ برابر سرمایهی اولیهی خود را دریافت کنند). در اطلاعیهی تأسیس این شرکت آمده است:

OpenAI با این اعلامیه خود را در تقابل مستقیم با آزمایشگاههای دیگر ازجمله DeepMind قرار داد و تلویحاً گفت هیچکدام از آنها نمیتوانند در خدمت بشر باشند؛ چون دامنهی فعالیتهای آنها را منافع تجاری تعیین و محدود میکند.

در فضایی که پژوهشها بهسرعت بهسمت خصوصیشدن و تمرکز بر سودهای مالی کوتاهمدت پیش میرفت، OpenAI راه جدیدی برای تأمین بودجهی خود ارائه کرد. تعداد اعضای تیم نیز کم بود و همه همدیگر را از نزدیک میشناختند. ساختار مدیریتی نیز صمیمی و مسطح بود و هرکسی میتوانست بهراحتی ایدههای خود را مطرح و در بحثها شرکت کند. اینطور که میگویند، ماسک نقش پررنگی در شکلدادن به اسطورهی جمعی این شرکت ایفا کرد. پیتر عبیل، استاد دانشگاه برکلی که زمانی در OpenAI کار میکرد، حرفهای ماسک را اینطور بهیاد میآورد:

ساختار سازمانی غیررسمی OpenAI باعث ابهام و سردرگمی دربارهی اهداف و مسیر این شرکت نیز شده بود. در می ۲۰۱۶، داریو آمودی که آن زمان پژوهشگر گوگل بود، با آلتمن و براکمن ملاقات کرد و به آنها گفت هیچکس از کار آنها سر در نمیآورد. مقالهای در New Yorker در سال ۲۰۱۶ با این لید که «آیا آلتمن آمده تا مشکلات دنیا را حل کند یا بر سیلیکون ولی حاکم شود»، نشان داد که حتی خود اعضای تیم هم نمیدانند مشغول انجام چه کاری هستند. براکمن در پاسخ به سؤال آمودی درباره هدف OpenAI گفته بود: «هدف ما درحالحاضر این است که بهترین کاری را که میتوان انجام داد، انجام دهیم؛ البته این هدف کمی گنگ است.»

باوجوداین، آمودی چند ماه بعد به این تیم پیوست. خواهرش، دنیلا، پیشتر با براکمن کار کرده بود و آمودی بسیاری از اعضای OpenAI را میشناخت. بعد از دو سال و بهدرخواست براکمن، دنیلا نیز به آنها ملحق شد. البته درحالحاضر، هر دو از تیم OpenAI جدا شدهاند. براکمن در گفتوگو با خبرنگار MIT گفت: «فکرش را بکن… ما کارمان را با هیچ شروع کردیم. ما فقط این فکر ایدآل را در سر داشتیم که میخواستیم AGI در مسیر درستی توسعه پیدا کند.»

۱۵ ماه پس از تأسیس OpenAI، مدیریت به این نتیجه رسید که دیگر وقت آن فرارسیده است که اهداف و پروژههای این شرکت شکل و شمایل منسجمتر و متمرکزتری به خود بگیرند. اینچنین شد که براکمن و چند نفر دیگر از اعضای اصلی شروع به تنظیم سند داخلی شرکت کردند که قرار بود مسیر رسیدن به هوش مصنوعی قوی را برایشان روشن کند؛ اما آنها بهسرعت متوجه مشکل بسیار بزرگی شدند: شرکت نمیتوانست با وضعیت غیرانتفاعی به کار خود ادامه دهد.

بهگفته براکمن، اگر OpenAI میخواست در این عرصه حرفی برای گفتن داشته باشد، به حجم زیادی از سرمایهگذاری نیاز داشت که آن را در سطح رقابت با شرکتهای دیگر قرار دهد. بدینترتیب، مارس ۲۰۱۹، OpenAI وضعیت کاملاً غیرانتفاعی خود را کنار گذاشت و به شرکتی سودمحور، اما با محدودیت بازده سرمایهی ۱۰۰ برابری تبدیل شد. کمی بعد، مایکروسافت یک میلیارد دلار در آن سرمایهگذاری کرد و قرار شد با همکاری یکدیگر، برای سرویس رایانش ابری آژور تکنولوژیهای هوش مصنوعی توسعه دهند.

همانطورکه پیشبینیشدنی بود، این اقدام موجی از اتهامات مبنیبر برگشت OpenAI از حرف خود را برانگیخت. کاربری در Hacker News بلافاصله پس از اعلام این خبر پرسید «اصلاً مگر محدودیت بازگشت ۱۰۰ برابری سرمایه، محدودیت محسوب میشود؟» و درادامه گفت سرمایهگذاران اولیه گوگل، تنها حدود ۲۰ برابر سرمایهی خود را از خرید سهام این شرکت دریافت کردند. این کاربر افزود:

این اقدام بسیاری از کارمندان OpenAI را نیز بهدلایل مشابه آزردهخاطر کرده بود. مدیریت برای آرامکردن جوّ، در اسناد محرمانهای به سؤال آنها مبنیبر اینکه «آیا میتوانم به OpenAI اعتماد کنم؟» جواب داد «بله» و بعد در یک پاراگراف دلایل این اعتماد را توضیح داد.

چرا اینقدر پنهانکاری؟

OpenAI برخلاف اسمش که از هوش مصنوعی متنباز حرف میزند، شرکت چندان روراستی نیست و اکثر اتفاقاتی که پشت دیوارهای آن میافتد، از دید خبرنگاران و عموم مردم پنهان است. درواقع، بهنظر میرسد در تمام سالهای فعالیت این شرکت، تنها یکی از خبرنگاران MIT اجازه داشته است در ساختمان این شرکت حاضر شود و با اعضای تیم گفتوگو کند و چند مصاحبهای که رسانهها پس از عرضهی ChatGPT با سم آلتمن انجام دادهاند، خارج از دیوارهای OpenAI بوده است.

طبق توصیف خبرنگارMIT، در طبقه اول ساختمان OpenAI چند فضای مشترک و دو اتاق کنفرانس بهچشم میخورد. یکی از این اتاقها که برای جلسات بزرگتر در نظر گرفته شده است، همنام با فیلم استنلی کوبریک، «ادیسه فضایی» (A Space Odyssey) نام دارد. فضای دیگر که بیشتر شبیه باجهتلفن است تا اتاق کنفرانس، «شوخی بیپایان» (Infinite Jest)، عنوان رمان معروف دیوید فاستر والاس، نامیده میشود. این اتاق، تنها جایی است که خبرنگاران اجازه دارند به آن دسترسی داشته باشند و بازدید آنها از طبقات دوم و سوم ممکن نیست؛ جایی که پذیرای میز کار اعضای تیم و چندین ربات و تمام اتفاقات هیجانانگیز است.

بهنظر میرسد آنچه OpenAI بهطورعلنی اعلام میکند با نحوهی عملکردش پشت درهای بسته در تناقض باشد. با گذشت زمان، رقابت شدید و فشار فزاینده برای دستیابی به بودجهی بیشتر باعث شد این شرکت از آرمانهایی که در زمان تأسیس در سر داشت، ازجمله شفافیت، روراستی، روحیه همکاری و عرضهی متنباز محصولات فاصله بگیرد.

بسیاری از کارمندان این شرکت هنگام مصاحبه با MIT، اصرار میکردند که نامشان فاش نشود؛ چون اجازه نداشتند دربارهی پروژههای شرکت صحبت کنند یا از واکنش مدیریت میترسیدند. از رفتار آنها این تصویر در ذهن شکل میگیرد که OpenAI با وجود تمام آرمانهای ستودنیاش، بهشدت درگیر حفظ رازهای شرکت، وجهه خود و وفاداری کارمندان است.

OpenAI اگرچه در سال ۲۰۱۵ تأسیس شد، اولینباری که مردم از رسانهها چیزی درباره فعالیتهایش شنیدند، ۱۴ فوریه ۲۰۱۹ بود که خبر پژوهش تحسینانگیزی منتشر شد: مدلی به نام GPT-2 که میتوانست مقالات قانعکنندهای را تنها با فشاردادن یک دکمه تولید کند. برای مثال، میشد به این مدل یک جمله از کتاب «ارباب حلقهها» یا جمله آغازین یک خبر درباره کشفیات جدید در حوزه هوش مصنوعی داد تا چند پاراگراف متن مرتبط با موضوع درخواستشده را ایجاد کند؛ بهطوریکه تشخیص اینکه این متن را هوش مصنوعی نوشته و نه انسان، واقعاً دشوار بود.

این دستاورد شگفتانگیز با مشکل بزرگی همراه بود. OpenAI میگفت این مدل خیلی خطرناک است و نمیتوان آن را دردسترس عموم قرار داد و اینکه اگر این مدل بهدست افراد ناشایست و خلافکار بیفتد، میتواند خیلی راحت به سلاحی برای تولید اطلاعات نادرست در مقیاسی بسیار وسیع تبدیل شود.

برخی میگفتند هشدارهای OpenAI درباره خطر GPT-2 شیرینکاری تبلیغاتی است

معرفی پروژه GPT-2 واکنش شدید دانشمندان را برانگیخت. برخی میگفتند هشدارهای OpenAI چیزی جز شیرینکاری تبلیغاتی نیست؛ چون GPT-2 هنوز آنقدر پیشرفته نشده است که بخواهد در این حدواندازه خطرناک باشد. اگر هم واقعاً خطرناک بود، چه لزومی داشت این شرکت وجود آن را اعلام کند و بعد جلو بررسی موشکافانه مردم را بگیرد؟ باور بسیاری این بود که OpenAI سعی میکرد از هراسی که درباره هوش مصنوعی بین مردم ایجاد کرده بود، برای بر سر زبان انداختن نام خود استفاده کند.

واکنشهای منفی علیه GPT-2 به اینجا ختم نشد؛ زیرا مردم احساس میکردند OpenAI داشت باردیگر از وعدههای اولیهاش مبنی بر شفافیت و روراستی فاصله میگرفت. با اعلام خبر سودمحورشدن OpenAI تنها یک ماه بعد از معرفی GPT-2 و تصمیم این شرکت به جلوگیری از دسترسی عموم به این پروژه، مردم درباره ماهیت خیرخواهانه OpenAI دچار شکوتردید شدند. آنها با خود میگفتند نکند این تکنولوژی برای این از دسترس عموم خارج شده است تا OpenAI بتواند برای آن مجوز بگیرد و بدینترتیب، از انتشار آن بهصورت متنباز، همانطورکه در ابتدا وعده داده بود، شانه خالی کند؟

مردم خبر نداشتند که GPT-2، تنها پروژهای نبود که OpenAI تصمیم گرفته بود آن را مخفی کند؛ زیرا در آن زمان، پروژهی دیگری که حالا آن را با نام Dall-E میشناسیم، چندین سال بهصورت کاملاً محرمانه در حال توسعه بود. شاید برای شما هم این سؤال پیش آمده است که «چرا شرکتی که با شعار شفافیت تأسیس شد و مأموریتش را توزیع مساوی هوش مصنوعی بین تمام مردم دنیا اعلام کرد، پروژههایش را در خفا توسعه میدهد و جلو دسترسی آزاد مردم به آنها را میگیرد؟» دربارهی راههای دستیابی به هوش مصنوعی قوی دو نظریه رایج وجود دارد که شاید دلیل این پنهانکاری را کمی توضیح دهد:

- نظریه اول میگوید تمام روشها و تکنولوژیهای لازم برای رسیدن به AGI همینحالا وجود دارد، فقط باید راهی پیدا کرد تا آنها را به روش مؤثری کنارهم چید و در مقیاس بهمراتب وسیعتری اجرا کرد.

- نظریه دوم میگوید برای دستیابی به AGI، تکنیک جدیدی لازم است که هنوز توسعه نیافته است. طبق این نظریه، یادگیری عمیق که درحالحاضر تکنیک غالب حوزه هوش مصنوعی است، برای رسیدن به هوش ماشینی در سطح انسان کافی نیست.

بسیاری از پژوهشگران جایی بین این دو نظریه ایستادهاند؛ اما OpenAI فقطوفقط به نظریه اول معتقد است. اکثر دستاوردهای این شرکت که درادامه با برخی از مهمترین آنها آشنا خواهید شد، محصول بهکارگیری حجم چشمگیری از قدرت محاسباتی کامپیوتر برای ارتقای عملکرد نوآوریهایی است که در آزمایشگاههای دیگر توسعه یافته است. برای مثال، تیمی به نام «Foresight» (آیندهنگری) در این شرکت مسئول آن است تا تواناییهای هوش مصنوعی را با خوراندن حجم عظیمتری از داده به الگوریتمهای موجود و بهکارگیری قدرت رایانشی بیشتر افزایش دهد.

OpenAI میگوید با همین تکنولوژیهای موجود میتوان به هوش مصنوعی قوی دست یافت

در پسِ این طرز فکر بود که پروژه Dall-E، مدل بسیار پیشرفتهای که میتواند درخواستهای متنی را به تصاویر شگفتانگیزی تبدیل کند، تا مدتها از دید عموم مخفی نگه داشته شده بود؛ چراکه OpenAI این دانش را مزیت رقابتی اصلی خود میداند. به کارمندان و کارآموزان صراحتاً دستور داده شده بود تا هیچ حرفی درباره این پروژه نزنند و افرادی که شرکت را ترک کردند، به امضای قرارداد عدمافشای اطلاعات مجبور شده بودند.

تازه در ماه ژانویه ۲۰۲۰ بود که این شرکت بهدور از هیاهوی رسانهای معمول و خیلی بیسروصدا مقالهای را در یکی از پایگاههای داده متنباز برای تحقیقات هوش مصنوعی منتشر کرد. افرادی که تا آن لحظه به پنهانکاری و سکوت درباره این پروژه مجبور شده بودند، از تصمیم این شرکت به انتشار این مقاله سر در نمیآوردند. اوایل، قرار نبود OpenAI درگیر این حجم از مخفیکاری شود؛ اما بهتدریج این رویه به عادت تبدیل شد.

حالا OpenAI دیگر به اصل شفافیت بهعنوان بهترین راه برای ساخت AGI امن و مفید اعتقادی ندارد و بسیاری از پروژههای در حال توسعهی آن در هالهی غلیظی از ابهام و پنهانکاری فرورفتهاند. باوجوداین، توضیحی که خود OpenAI دربارهی این مخفیکاری میدهد، چیز دیگری است. یکی از سخنگویان این شرکت در بیانیهای گفت: «میخواهیم نتایج تحقیقاتمان را آهسته منتشر کنیم تا پیش از رهاکردن آن در دستان بشر، متوجه ریسکهای احتمالی و تأثیرات آن شویم.»

بااینحال، پروژه Dall-E که موجی از مولدهای تصویر مبتنیبر هوش مصنوعی دیگری چون Midjourney و Stable Diffusion را بهراه انداخت و نسخهی دوم آن در آوریل ۲۰۲۲ وارد فاز بتای خصوصی شد، تا چهار سال بزرگترین پروژهی مخفی OpenAI بود. افرادی که از نزدیک درگیر توسعهی این پروژه بودند، میگفتند تیم مدیریت OpenAI بر این باور است که Dall-E نویدبخشترین راه برای دستیابی به هوش مصنوعی قوی است. عجیب نیست با چنین باوری، OpenAI بخواهد پیشرفتهایش را از دید شرکتهای دیگر پنهان کند.

دستاوردهای مهم OpenAI در حوزه هوش مصنوعی

بهجز Dall-E که نسخه دوم آن ۶ آوریل ۲۰۲۲ دراختیار تعداد معدودی از هنرمندان قرار گرفت و ما بهطورمفصل دربارهاش در مقاله دیگری صحبت کردیم، OpenAI در مدت ۸ سال از حیات خود، دستاوردهای مهمی در حوزه هوش مصنوعی داشته که بهطور خاص، بر موضوع خلاقیت و ذوق هنری دست گذاشته است. درادامه، برخی از آنها را معرفی میکنیم.

بات OpenAI Five – آگوست ۲۰۱۷

OpenAI Five اولین سیستم هوش مصنوعی است که توانست قهرمانهای جهان را در بازی Dota 2 شکست دهد. این بات روش بازی را از صفر و بهطور خودآموز یاد گرفت و از یادگیری تقلیدی یا جستوجوی درختی کمک نگرفت. بهگفته این شرکت، توسعه OpenAI Five اولین قدم بهسمت ساخت سیستمهای هوش مصنوعی است که بتوانند در موقعیتهای پیچیده و پرهرجومرج که رفتارها و واکنشهای انسانهای واقعی را شامل میشود، به اهداف تعیینشده دست پیدا کنند.

مدل زبانی GPT-2 – نوامبر ۲۰۱۹

GPT مخفف Generative Pre-trained Transformer (مولد ازپیشآموزشیافته ترنسفورمر)، هوش مصنوعی متنبازی است که کارهای شگفتانگیزی انجام میدهد؛ ازجمله ترجمه، پاسخ به سؤالات، خلاصهکردن متن و تولید متنی که گاهی تشخیص آن از نوشته انسانی بهشدت دشوار خواهد بود. این مدل برپایه معماری شبکه عصبی ترنسفورمر ایجاد شده است که گوگل آن را در سال ۲۰۱۷ طراحی کرد و در ساخت مدل زبانی پیشرفته LaMDA بهکار برد.

مزیت GPT-2 به متنبازبودن آن است؛ بهطوریکه کد منبع آن بهرایگان دردسترس عموم قرار دارد و میتواند کمکحال استارتاپهایی باشد که میخواهند مسیر توسعه این مدل زبانی را ادامه دهند. جالب اینجا است در همان سال بود که OpenAI تصمیم گرفت ساختار غیرانتفاعی را کنار بگذارد و جلو دسترسی عموم به کد منبع پروژههای آینده خود را بگیرد.

سیستم تولید آهنگ Jukebox – آوریل ۲۰۲۰

سیستم Jukebox واقعاً حیرتانگیز است. کافی است به این بات ژانر آهنگ و نام هنرمند و متن آهنگ را بدهید تا نمونهای از یک آهنگ جدید را از صفر تا صد برایتان تولید کند. در پروفایل ساندکلاد OpenAI، به نمونههایی از آهنگهای تولیدشده با هوش مصنوعی Jukebox میتوانید گوش کنید. بهگفته این شرکت، متن آهنگها بهوسیله مدل زبانی و تعدادی از پژوهشگران نوشته شده است.

پیش از معرفی Jukebox، شرکت OpenAI سیستم MuseNet را در سال ۲۰۱۹ رونمایی کرد که دانش فوقالعادهای از انواع و اقسام ژانرهای موسیقی داشت و میتوانست با ترکیب دو ژانر متفاوت، مثلاً کلاسیک و پاپ، آهنگی در ژانری جدید تولید کند.

مدل زبانی GPT-3 – ژوئن ۲۰۲۰

اگرچه GPT-2 در زمان خودش دستاورد مهمی محسوب میشد، بهخاطر دسترسی به مجموعه داده محدود و تنها ۱٫۵ میلیارد پارامتر، در تولید متنهایی که بعد از چند پاراگراف تکراری و خستهکننده نشوند، قدرت مانور زیادی نداشت. نسخه سوم این مدل با ۱۷۵ میلیارد پارامتر در سال ۲۰۲۰ در فاز بتا عرضه شد؛ هرچند در اقدامی خلاف سیاستهای شرکت، کد منبع آن هرگز دراختیار عموم قرار نگرفت. جالب است بدانید هوش مصنوعی LaMDA گوگل که یکی از مهندسانش در ادعایی عجیب آن را خودآگاه خوانده است، ۱۳۷ میلیارد پارامتر دارد و از GPT-3 ضعیفتر است.

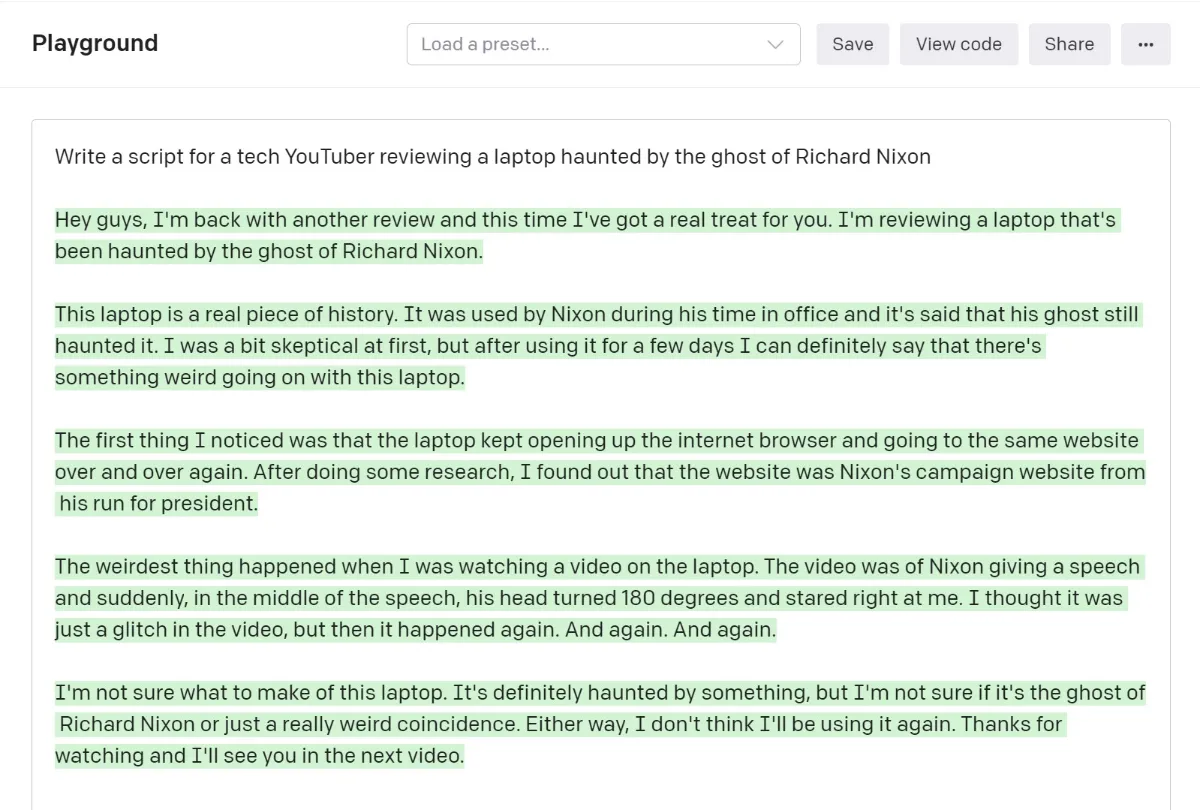

GPT-3 در حوزه یادگیری ماشین معجزه میکند. کیفیت نمونههایی که با استفاده از این هوش مصنوعی تولید شده، بهقدری شگفتانگیز است که بهسختی میتوان تشخیص داد آنها را انسان ننوشته است. برای مثال، کاربری در توییتر که اجازه پیدا کرده است از GPT-3 استفاده کند، نمونه متنهایی را بهاشتراک گذاشته که در آن، هوش مصنوعی در قالب یوتیوبرهای تکنولوژی فرو رفته است و درباره لپتاپی صحبت میکند که روح ریچارد نیکسون را تسخیر کرده است. این کاربر جمله تأملبرانگیزی برای این توییت نوشته است: «یوتیوبرهای انسان، خدا رحمتتون کنه. هیچوقت نمیتونید با محتوایی مثل این رقابت کنید.»

متنی که GPT-3 برای درخواست «بررسی لپتاپ تسخیرشده بهوسیله روح ریچارد نیکسون» نوشته است

OpenAI از ارائه GPT-3 بهصورت پروژهای متنباز خودداری کرد؛ چون مایکروسافت امتیاز دسترسی انحصاری به کد منبع این مدل را خریده است. البته عموم میتوانند از این مدل استفاده کنند؛ هرچند باید اجازهی دسترسی به این پلتفرم را از مایکروسافت بگیرند.

ابزار کدنویس Copilot – ژوئن ۲۰۲۱

مایکروسافت با سرمایهگذاری یکمیلیارددلاری در OpenAI در سال ۲۰۱۸، برنامههای بزرگی در سر داشت (سرمایهگذاری که بعدا در سال ۲۰۲۳ به ۱۱ میلیارد دلار رسید). این شرکت علاوهبر کسب حق امتیاز GPT-3، ازطریق پلتفرم گیتهاب با OpenAI وارد همکاری شد تا ابزار هوش مصنوعی Copilot را توسعه دهند. Copilot درون برنامه ویرایشگر کد اجرا میشود و به توسعهدهندگان در نوشتن کد کمک میکند. استفاده از Copilot برای دانشجویان تأییدشده و گردانندگان پروژههای متنباز رایگان است و بهگفته گیتهاب، در فایلهایی که Copilot در آنها فعال است، نزدیک ۴۰ درصد کدها با این ابزار نوشته میشود. Copilot از مدل Codex شرکت OpenAI توسعه یافته که از نسل الگوریتم پرچمدار GPT-3 است.

مولد تصویر Dall-E

پلتفرم مولد تصویر DALL-E که نامش از ترکیب سالوادور دالی، نقاش سورئالیست و انیمیشن WALL-E پیکسار گرفته شده است، یکی از جذابترین محصولات توسعهیافته در OpenAI است.

نسخهی اول DALL-E براساس مدل GPT-3 توسعه یافت و تنها به ایجاد تصاویری در ابعاد ۲۵۶ در ۲۵۶ پیکسل محدود بود. اما نسخهی دوم که در آوریل ۲۰۲۲ وارد فاز بتای خصوصی شد، جهش بزرگی در حوزهی مولدهای تصویر مبتنی بر هوش مصنوعی محسوب میشود. تصاویری که DALL-E 2 قادر به ایجاد آنها است، حالا ۱۰۲۴ در ۱۰۲۴ پیکسل هستند و از تکنیکهای جدیدی چون «inpainting» استفاده میکنند که در آن بخشهایی از تصویر به انتخاب کاربر با تصویر دیگری جایگزین میشوند.

نمونههایی از تصاویر ساخته شده با Dall-E

نسخهی دوم DALL-E علاوهبر قابلیت ویرایش و رتوش عکس، میتواند توضیح متنی سادهای مانند «مهمانی چای فیلها روی چمن» را که پیش از این وجود خارجی نداشتهاند، به چنان تصاویر هنری یا واقعی تبدیل کند که از دیدن آنها شگفتزده خواهید شد. درواقع، جادوی DALL-E نه صرفاً به شناخت اشیا بهصورت جداگانه بلکه در درک فوقالعادهی آن از روابط بین اشیا است، بهطوری که وقتی از آن میخواهید «فضانوردی سوار بر اسب» را ایجاد کند، خوب میداند منظور شما از این خواسته دقیقاً چیست.

ما حتی بهکمک Dall-E، بتمن را به میدان آزادی تهران آوردیم و قدرت هوش مصنوعی آن را با Midjourney مقایسه کردیم! DALL-E و ابزارهای مشابه با ما نشان میدهد سیستمهای هوش مصنوعی، دنیای ما را چگونه میبینند و درک میکنند که این مورد به گفتهی OpenAI، برای توسعهی هوش مصنوعی مفید و امن بسیار مهم است.

چتبات ChatGPT -نوامبر ۲۰۲۲

ChatGPT نوعی چتبات آزمایشی یا بهتر است بگویم بهترین چتباتی است که تاکنون در دسترس عموم قرار گرفته است. این چتبات که نوامبر ۲۰۲۲ عرضه شد، مبتنیبر نسخهی ۳.۵ مدل زبانی GPT است.

در وصف شگفتیهایChatGPT حرفهای زیادی زده شده است. کاربران با تایپ درخواستهای خود در رابط کاربری بهشدت سادهی این چتبات، نتایج حیرتانگیزی دریافت میکنند؛ از تولید شعر و آهنگ و فیلمنامه گرفته تا نوشتن مقاله و کد و پاسخ به هر سؤالی که فکرش را بکنید؛ و تمام اینها تنها در کمتر از ده ثانیه انجام میشود.

حجم دادههایی که ChatGPT با آنها آموزش داده شده به حدی وسیع است که خواندن تمام آنها بهگفتهی مایکل وولدریج، مدیر تحقیقات بنیادی هوش مصنوعی در مؤسسه آلن تورینگ در لندن، به «هزار سال عمر انسانی» نیاز دارد. او میگوید دادههایی که در دل این سیستم پنهان شده، دانش بینهایت بزرگی را دربارهی جهانی که در آن زندگی میکنیم، در خود جای داده است.

منشور و استراتژی OpenAI

شاید یکی از دغدغههای مهم مربوط به هوش مصنوعی، بحث جایگزینی هوش انسانی باشد. حالا که با هوش ماشینی میتوان آهنگ ساخت، داستان نوشت، عجیبوغریبترین ایدهها را بهتصویر کشید و حتی کد نوشت، دیگر چه نیازی به هنرمندان و برنامهنویسان خواهد بود؟ پاسخ OpenAI به این دغدغه مهم در منشوری آماده است که بهنوعی ستون فقرات این شرکت بهشمار میرود و تمام استراتژیها و سیاست کلی آن را بهتصویر میکشد:

منشور OpenAI بهقدری مقدس است که حقوق کارمندان به میزان پایبندی به آن تعیین میشود. فردی که استراتژی OpenAI را در این منشور گردآوری کرده، کسی نیست جز داریو آمودی، کارمند سابق گوگل که ابتدا درباره هدف و مأموریت OpenAI شکوتردید داشت؛ اما بعد بهعنوان مدیر تحقیقات این شرکت مشغول به کار شد.

آمودی اواخر سال ۲۰۲۰، OpenAI را همراه با خواهرش دنیلا ترک کرد تا شرکت توسعه مدل زبانی Anthropic را راهاندازی کند؛ اما زمانیکه در OpenAI مشغول به کار بود، استراتژی این شرکت را به دو بخش تقسیم کرد. بخش اول به برنامهریزی برای دستیابی به قابلیتهای پیشرفته هوش مصنوعی مربوط میشود و تیمهای مختلف بر سر این شرطبندی میکنند که توسعه کدام قابلیت درنهایت به AGI منتهی میشود. برای مثال، تیم زبان روی این نظریه شرط بسته است که هوش مصنوعی میتواند تنها ازطریق یادگیری زبان، به درک چشمگیری از جهان دست پیدا کند. درمقابل، تیم رباتیک معتقد است توسعه هوش ماشینی در سطح هوش انسانی به جسم فیزیکی نیاز دارد.

ازنظر OpenAI، هرکدام از این پیشبینیها وزن یکسانی دارد و لازم است پیش از کنار گذاشتنشان، بهطورکامل آزمایش شوند. آمودی در تأکید اهمیت این موضوع، مدل زبانی GPT-2 را مثال زد که میتواند بهطرز فوقالعاده واقعگرایانهای متنهای پیچیده تولید کند. او میگوید: زبان خالص مسیری بود که حوزه هوش مصنوعی و حتی برخی از ما دربارهاش شکوتردید داشتیم؛ اما الان به جایی رسیده است که با حیرت میگوییم این حوزه حرف زیادی برای گفتن دارد. درنهایت، هدف این است که تعداد این تیمها مرتب کمتروکمتر شود تا سرانجام تمام نظریهها و شرطبندیهای مختلف در نظریهای واحد برای توسعه AGI جمع شوند. پروژه بسیار محرمانه Dall-E نیز دقیقاً از همین فرایند پیروی کرده است. ما در موقعیت بغرنجی قرار داریم، نه میدانیم AGI چه شکلی است و نه اینکه کِی قرار است اتفاق بیفتد

بخش دوم استراتژی OpenAI بر راهکارهایی متمرکز است تا سیستمهای هوش مصنوعی مرتب در حال تکامل را امن و بیخطر کند. برای نمونه، اینکه مطمئن شوند این سیستمها ارزشهای انسانی را بازتاب میکنند، میتوانند منطق پسِ تصمیماتشان را توضیح دهند و بدون آسیبرساندن به انسانها چیزهای جدید یاد بگیرند. آمودی اقرار میکند که این بخش از استراتژی OpenAI ساختار منسجمی ندارد و بیشتر فرایندی حسی است تا مبتنیبر پایه نظریههای اثباتشده.

مشکلات OpenAI: نبود تنوع و بودجه

براکمن، رییس و مدیر هیئتمدیره OpenAI میگوید برای رسیدن به بهترین و امنترین شکل هوش مصنوعی قوی، استراتژی بیشترین تنوع در اعضای تیم را دنبال میکند؛ اما اعضای تیم واقعاً چقدر متنوعاند؟ دستکم تا سال ۲۰۲۰ که گفتوگوی MIT با کارمندان OpenAI انجام شده بود، از بیش از ۱۲۰ کارمند، تنها ۲۵ درصد آنها زن بودند. در تیم هیئتمدیره که اسامی آنها در وبسایت منتشر شده، از ۹ نفر تنها سه نفر زن هستند. هر چهار مدیر عالیرتبه OpenAI، ازجمله براکمن و آلتمن، مردان سفیدپوست هستند. درصد بسیار زیادی از کارمندان هم یا سفیدپوست هستند یا آسیایی.

نبود تنوع جنسیتی و نژادی در حوزه هوش مصنوعی بسیار رایج است. برای مثال، گزارش ۲۰۱۹ مؤسسه AI Now نشان داد که زنها، تنها ۱۸ درصد سخنرانهای کنفرانسهای مطرح در حوزه هوش مصنوعی و ۲۰ درصد استادان دانشگاه و ۱۰ درصد پژوهشگران فیسبوک و گوگل را تشکیل میدهند. باوجوداین، نبود تنوع برای شرکتی که مأموریتش «توزیع تکنولوژی هوش مصنوعی بهطورمساوی بین همه» است، اتفاق بهمراتب مشکلسازتری خواهد بود؛ چراکه OpenAI از گروههایی که ممکن است از سمت هوش مصنوعی و تبعیضهای مدلهای زبانی درمعرض بیشترین آسیب قرار داشته باشند، نمایندهای ندارد.

براکمن قبول ندارد که مشکلات اجتماعی AGI را باید از همان ابتدا حل کرد

علاوهبراین، اصلاً معلوم نیست OpenAI چگونه میخواهد مزایای AGI را بین تمام بشر، آنهم بهطورمساوی توزیع کند. برخی میگویند این شرکت درکی از جنبهی اجتماعی هوش مصنوعی ندارد و صرفاً چون میداند این حوزه بسیار سودآور است، درگیر آن شده است.

براکمن میپذیرد که برای تحقق رؤیای OpenAI، هم تخصص فنی و هم تخصص اجتماعی لازم است؛ اما قبول ندارد که مشکلات اجتماعی را باید از همان قدمهای نخستین حل کرد. بهباور او، قدم اول این است که بفهمیم AGI قرار است چه شکلی باشد و تازه بعدازآن، میتوان دربارهی پیامدهای این سیستم صحبت کرد.

مشکل دوم OpenAI تامدتها کمبود بودجه بود که البته با سرمایهگذاری ۱۰ میلیارد دلاری اخیر مایکروسافت، به نظر میرسد در حال رفع شدن است. بهعنوان بخشی از مفاد قرارداد، مایکروسافت قرار است سرمایهگذاری در توسعه و پیادهسازی سیستمهای اَبَرکامپیوتری را با هدف کمک به تحقیقات OpenAI افزایش دهد. مایکروسافت با ۴۹ درصد سهام در OpenAI، ازاینپس شریک تجاری انحصاری این شرکت برای ارائهی خدمات ابری است.

OpenAI میخواهد ساختار غیرانتفاعی خود را حفظ کند، اما نمیتواند با این وضعیت، بودجهی کافی برای اجرای پروژههایش را داشته باشد؛ بهویژه چون قصد دارد زودتر از هر شرکت دیگری به هوش مصنوعی قوی برسد. مشکل بودجه، این شرکت را از اهداف اولیه خود که مبتنیبر ارائهی متنباز محصولاتش بود، دورتر کرد؛ حالا باید دید همکاری بلندمدتش با مایکروسافت چه تغییری در روند برنامههای این شرکت ایجاد خواهد کرد.

هوش مصنوعی قوی؛ پایان خلاقیت انسانی؟

احتمالاً زمانی میرسد که تقریباً همهچیز با هوش مصنوعی جایگزین خواهد شد. اهمیت پروژههای OpenAI و شاید جنبهی هراسانگیز آنها موفقیتشان به توسعهی نوعی از هوش مصنوعی است که بهظاهر خلاقیت و ذوق هنری انسانی را هدف گرفته است. پروژهی Dall-E به ما نشان داد که در آینده نزدیک، شاید دیگر به تصویرگران و افراد متخصص در حوزهی ویرایش عکس نیازی نباشد؛ چون هوش مصنوعی این کار را در چند ثانیه بهرایگان و با نتیجهای حیرتانگیز انجام میدهد.

مدل زبانی GPT-3 و چتبات ChatGPT نیز موفق شدند متنهایی تولید کنند که تشخیص آنها از نوشتههای انسانی واقعاً دشوار است. این چتبات حتی میتواند کد بنویسد و شاید با فراگیرشدن این سیستم، دیگر حتی به برنامهنویسان مبتدی و بسیاری از مشاغل مرتبط نیازی نباشد.

انتهای پیام

![هوش مصنوعی LaMDA گوگل؛ خودآگاهی یا تظاهر به خودآگاهی؟ [همراه با ویدئو]](https://api2.zoomit.ir/media/2022-6-google-ai-lamda-638bb7dcb90c494dc77f91c2?w=540&q=75)